고정 헤더 영역

상세 컨텐츠

본문

Perceptron

지난 게시물에서 했던 과정을 퍼셉트론이라고 한다.

즉 퍼셉트론이란 입력과 가중치들의 곱을 모두 더한 뒤 활성화 함수(activation function)을 적용해서 그 값이 0보다 크면 1, 0보다 작으면 -1을 출력하는 선형분류기 구조를 말한다.

단층 퍼셉트론

지금까지 배운 퍼셉트론을 단층 퍼셉트론이라고 한다. 퍼셉트론은 단층 퍼셉트론과 다층 퍼셉트론으로 나누어지는데, 단층 퍼셉트론은 값을 보내는 단계와 값을 받아서 출력하는 두 단계로만 이루어진다. 이때 이 각 단계를 보통 층 (layer)이라고 부르며, 이 두개의 층을 입력층(input layer)과 출력층(output layer)이라고 한다.

강의에서 예시를 든 퍼셉트론을 살펴보자 입력 세 개 중 하나는 편의를 위해 1이라고 가정되었다.

계산 식을 통해 우리는 직선의 방정식을 구할 수 있다.

각종 연

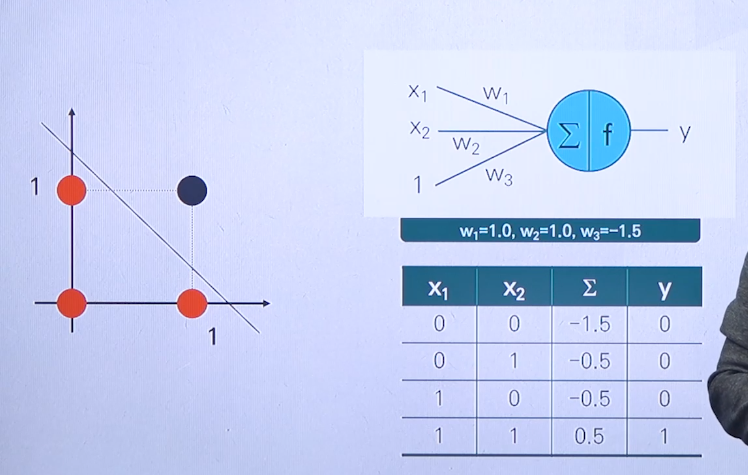

이제 위에서 구한 식을 통해 and연산을 해보자

and연산이 성립되기 위해 w를 구하면 다음의 사진과 같다.

이렇게 w 값을 잘 설정해주기만 하면 우리는 퍼셉트론에서 and 연산을 할 수 있다.

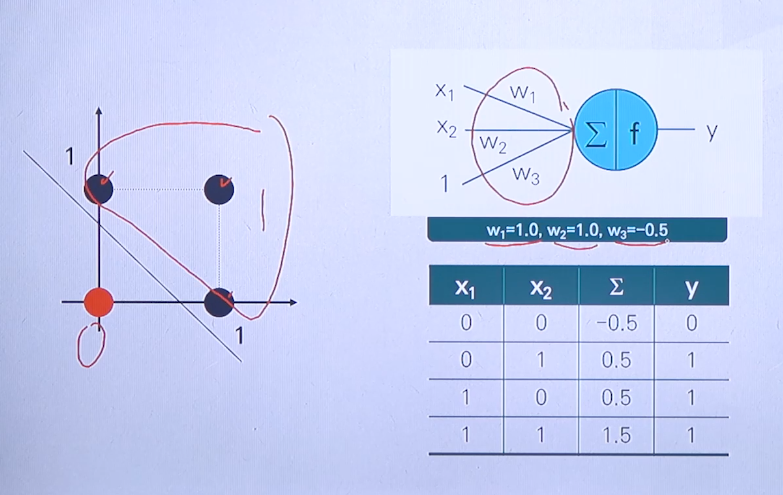

or연산 값은 다음과 같다.

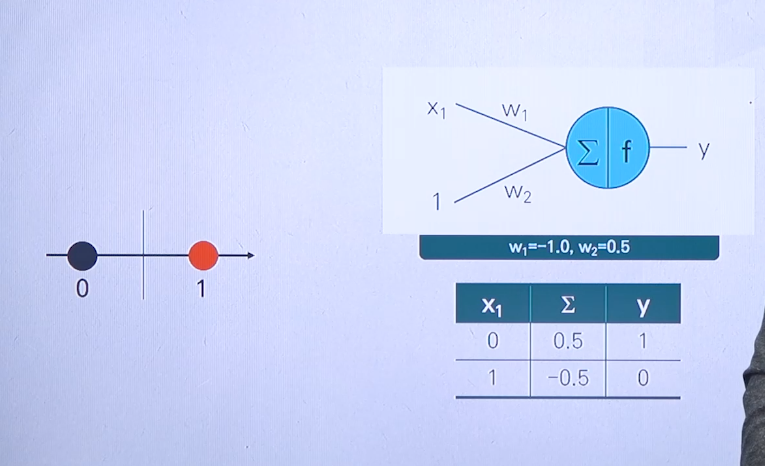

not 연산은 어떻게 되는냐? 이것도 가능하다

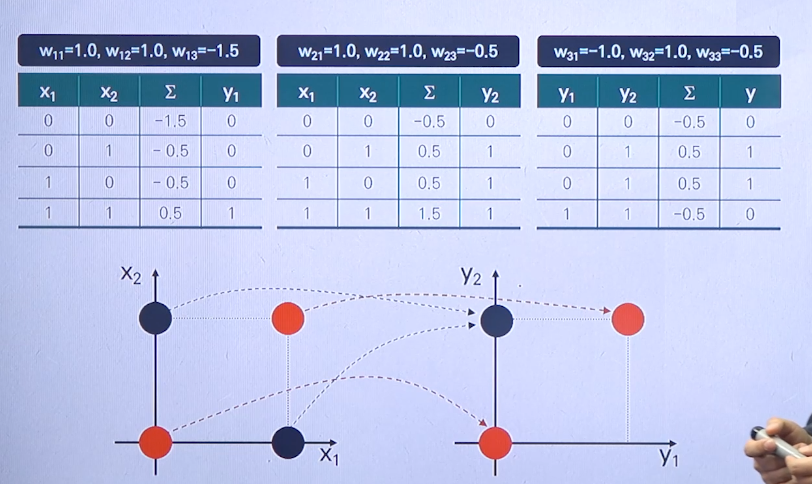

exclusive or 연산(xor)은 조금 다른 형태로 수행되는데

위 그림을 통해 우리는 직선 하나로 이것들을 구분할 수 없음을 알 수 있다. 그럼 어떻게 해야 되는냐?

직선을 두개 만들면 된다!

이것이 다층 퍼셉트론을 이해하기 위한 개념이라고 할 수 있다.

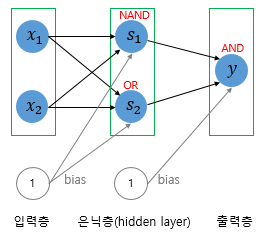

다층 퍼셉트론(MultiLayer Perceptron)

xor 연산은 기존의 and , or, not 을 조합하면 만들 수 있다. 퍼셉트론 관점에서 말하면 층을 더 쌓으면 만들 수 있다는 이야기이다. 다층 퍼셉트론과 단층 퍼셉트론의 차이는 단층 퍼셉트론은 입력층과 출력층만 존재하지만, 다층 퍼셉트론은 중간에 층을 더 추가하였다는 점이다. 이렇게 입력층과 출력층 사이에 존재하는 층을 은닉층(hidden layer)이라고 한다. 즉 다층 퍼센트론은 중간에 은닉층이 존재한다는 점이 단층 퍼셉트론과 다르다. 다층 퍼셉트론은 줄여서 MLP라고도 불린다.

'AI' 카테고리의 다른 글

| [혼자 공부하는 머신러닝+딮러닝] 회귀 알고리즘과 모델 규제 - k 최근접 이웃 회귀 (1) | 2023.10.28 |

|---|---|

| [딮러닝 튜토리얼] 섹션 1 - 3. Learning Algorithm 기초 (0) | 2023.10.10 |

| [딮러닝 튜토리얼] 섹션 1 - 1.Neural Network 소개 (0) | 2023.10.10 |

| [혼자 공부하는 머신러닝+딮러닝]데이터 다루기 - 데이터 전처리 (1) | 2023.10.06 |

| [혼자 공부하는 머신러닝+딮러닝]데이터 다루기 - 훈련 세트와 테스트 세트 (0) | 2023.10.05 |